Stell dir vor: Du trainierst ein internes Sprachmodell auf Kundendaten, Vertragsunterlagen und proprietären Geschäftsinformationen. Das Modell liefert gute Ergebnisse. Dein Team ist zufrieden. Und dann fragt dich jemand aus dem Rechtsteam: «Wo laufen diese Workloads eigentlich?»

Für viele Unternehmen ist die ehrliche Antwort: Auf AWS. Oder Azure. Oder GCP. Also auf Servern in den USA, oder auf Servern von US-Unternehmen, egal wo auf der Welt sie stehen.

Wer KI-Infrastruktur aufbaut, sollte vier Fragen frühzeitig klären, bevor das Projekt läuft und die Daten schon irgendwo verarbeitet werden.

1. Wo werden meine Daten verarbeitet und wer kann darauf zugreifen?

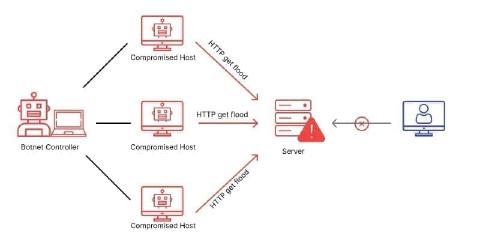

Die meisten Unternehmen wissen, dass ihre Daten «irgendwo in der Cloud» liegen, aber nicht genau wo, und erst recht nicht, wer im Zweifel darauf zugreifen kann. Der CLOUD Act (Clarifying Lawful Overseas Use of Data Act) ist ein US-amerikanisches Bundesgesetz aus dem Jahr 2018. Er verpflichtet US-Unternehmen dazu, US-Behörden auf Anfrage Zugriff auf gespeicherte Daten zu gewähren, auch wenn diese Daten physisch ausserhalb der USA gespeichert sind.

Das bedeutet: AWS, Microsoft Azure und Google Cloud sind US-Unternehmen. Ihre Rechenzentren in Frankfurt, Amsterdam oder Zürich ändern daran nichts. Sobald dein Anbieter einer US-Jurisdiktion unterliegt, können US-Behörden unter bestimmten Voraussetzungen Zugriff auf deine Daten verlangen, ohne dein Wissen und ohne Einbezug von Schweizer Gerichten.

2. Was genau verarbeite ich, und wie sensibel sind diese Daten?

Beim Training eines Sprachmodells werden Daten nicht einfach gespeichert: Sie werden verarbeitet, analysiert und in das Modell eingebettet. Das können sein:

- Kundenkommunikation und Support-Tickets

- Vertragsdokumente und juristische Unterlagen

- Medizinische oder finanzielle Daten

- Interne Wissensdatenbanken und proprietäre Prozesse

Diese Daten definieren, was dein Modell kann und wie es antwortet. Sie sind nicht irgendwelche Files auf einem Server. Sie sind der Kern deines Wettbewerbsvorteils.

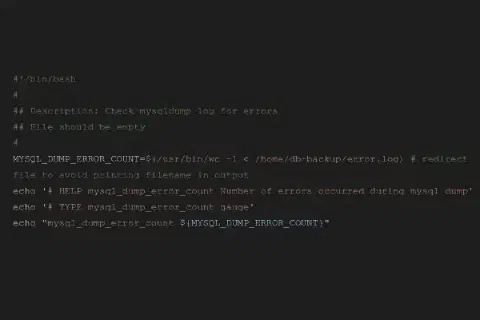

Dasselbe gilt für Inferenz und Fine-tuning: Auch wer kein eigenes Modell trainiert, sondern Kundendaten durch ein bestehendes Modell verarbeitet, ist betroffen. Wenn diese Daten auf US-Infrastruktur verarbeitet werden, unterliegen sie dem CLOUD Act. Das ist kein hypothetisches Risiko, sondern ein strukturelles.

3. Kann ich Datensouveränität gegenüber Aufsichtsbehörden nachweisen?

Für Unternehmen in regulierten Branchen ist die Lage noch klarer. Finanzinstitute, die der FINMA unterstehen, müssen Datensouveränität nachweisen können. Im Gesundheitsbereich gelten strenge Vorgaben zur Verarbeitung sensibler Personendaten. Für die öffentliche Hand ist der Einsatz von US-Infrastruktur für kritische Workloads oft schlicht nicht zulässig.

Das bedeutet: Viele Unternehmen in der Schweiz, die heute ihre KI-Workloads auf AWS oder Azure betreiben, sitzen auf einem Compliance-Problem. Nicht weil sie nachlässig sind, sondern weil die Alternative nicht auf dem Radar war.

4. Habe ich einen Ansprechpartner, der meinen Workload technisch versteht?

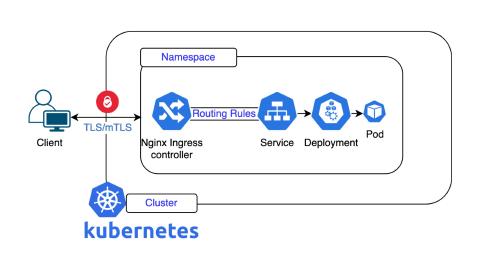

KI-Infrastruktur ist kein Standardprodukt. Die Anforderungen unterscheiden sich je nach Workload erheblich: Training grosser Sprachmodelle, schnelle Inferenz, Fine-tuning oder RAG-Systeme stellen unterschiedliche Anforderungen an Hardware, Netzwerk und Konfiguration.

Wer diese Fragen mit einem anonymen L1-Ticketsystem klären muss, verliert Zeit und Nerven. Peak Privacy, ein Unternehmen, das auf LLM-Inferenz spezialisiert ist, hat den Wechsel gemacht. Fabio Duò, Gründer von Peak Privacy, beschreibt es so:

«Die Zusammenarbeit mit Nine war ein echter Glücksgriff. Endlich haben wir einen Partner in der Schweiz gefunden, der nicht nur unsere spezifischen Bedürfnisse für LLM-Inferenz versteht, sondern auch die technische Expertise besitzt, eine darauf perfekt zugeschnittene, performante und preislich attraktive Serverlösung zu bauen. Das war ein Game Changer für uns.»

Was Peak Privacy beschreibt, ist kein Einzelfall: Wer einmal mit einem Team arbeitet, das dedizierte AI-Workloads versteht, direkt erreichbar ist und sich nicht hinter einem L1-Ticketsystem versteckt, will nicht zurück.

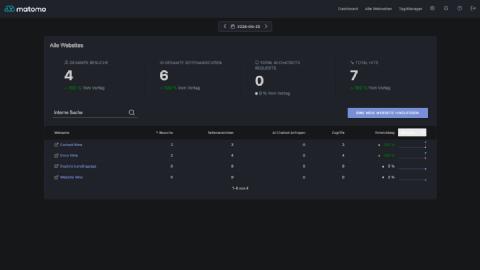

Die Schweizer Alternative

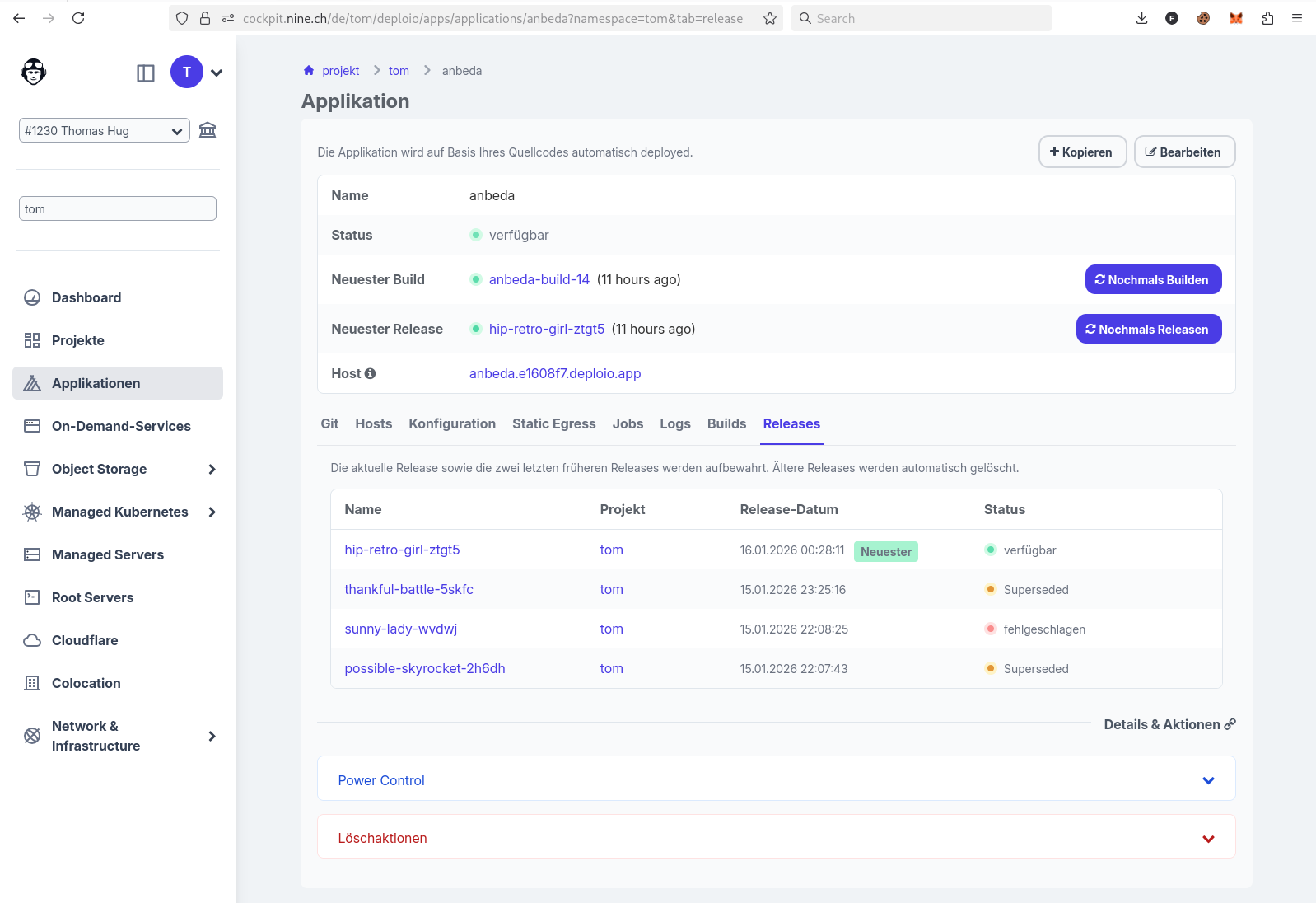

Wir betreiben dedizierte Nvidia-Hardware in Schweizer Rechenzentren (NTS Altstetten und NTT Rümlang, beide mit erneuerbarer Energie). Keine US-Muttergesellschaft, keine US-Jurisdiktion. ISO 27001 zertifiziert seit 2013.

Zur Verfügung stehen verschiedene GPU-Konfigurationen, passend zum Workload:

- Nvidia H100 NVL: maximale Performance für das Training grosser Sprachmodelle

- Nvidia L40s: optimiert für schnelle Inferenz und produktiven LLM-Betrieb

- Nvidia RTX 4500 ADA: effizient für Fine-tuning, RAG-Systeme und schlanke AI-Anwendungen

- Nvidia A100 40GB: bewährte AI-GPU für anspruchsvolle Training- und Inferenz-Workloads

Alle Konfigurationen sind dediziert: keine geteilten Ressourcen, keine unbekannten Nachbarn, echte bare-metal Performance.

Fazit

AWS ist nicht falsch, aber es ist nicht für alle Workloads die richtige Wahl. Wer mit sensiblen Daten KI-Modelle trainiert, wer in einer regulierten Branche arbeitet oder wer schlicht die Kontrolle über seine Daten behalten will, braucht eine Alternative.

Diese Alternative existiert. Sie läuft auf Schweizer Boden, ist ISO-zertifiziert und wird von Engineers betreut, die du direkt anrufen kannst.

Für einen strukturierten Einstieg: die KI-Compliance-Checkliste für Schweizer Unternehmen – mit den wichtigsten Punkten kompakt auf einer Seite, kostenlos herunterladbar.

Bereit, den richtigen Stack für deine AI-Workloads zu finden? Jetzt Beratungsgespräch buchen.